В 2024 году произошла масштабная утечка внутренних документов Google, содержащих 2500 страниц с подробной информацией о механизмах ранжирования сайтов. Документы раскрыли реальные факторы, влияющие на выдачу, которые как оказалось не сильно то и соответствуют официальным заявлениям Google.

С тех пор как эти документы попали в сеть, в рунете периодически появлялись статьи и видео с очень кратким и поверхностным содержанием, но без особого разбирательства и каких либо выводов по этому поводу. Делюсь выводами из собственного анализа слитых документов.

Собрал ключевые инсайты из утечки, которые как по мне слишком мало затронуты в интернете и многие сео-специалисты не говорят об этом. Особенно будет полезно молодым и начинающим сеошникам, которые еще верят в сказки гугла и прислушиваются ко всем их рекомендациям.

Оглавление:

- Клики и поведенческие факторы важнее контента

- Google использует все данные о ваших действиях из Chrome

- Белые списки сайтов

- Авторитет домена (siteAuthority) существует

- Новые сайты попадают в песочницу Google

- Размер бренда влияет на ранжирование

- Фильтрация небольших сайтов

- Метрика Font Size влияет на SEO

- Google активно понижает сайты за неправильные ссылки

- Что теперь делать и как менять SEO стратегию?

Клики и поведенческие факторы важнее контента

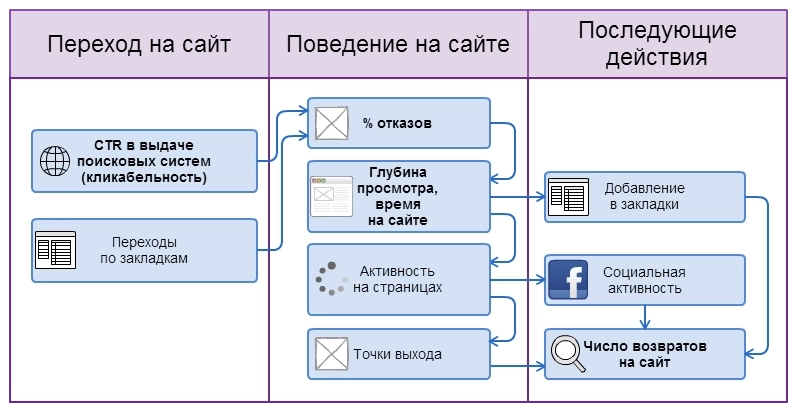

Google активно анализирует поведение пользователей с помощью (NavBoost):

- Количество и качество кликов.

- Время, проведенное на странице.

- Быстрые возвраты (pogo-sticking).

Вы скажете это но новость и все значют что ПФ (поведенческий фактор) давно используется гуглом и все об этом знают. Так вот чтоб вы знали никакой ваш полезный, экспертный и уникальный контент не поможет продвинуть сайт и получить хорошие позиции в выдаче если у вас будет низкое качество кликов и быстрые выходы (малое время проведенное на вашем сайте).

Из этого можно сделать такой вывод: конкуренты могу скрутить вам ПФ и это реально сработает.

Google использует все данные о ваших действиях из Chrome

Google официально говорит, что не использует данные браузера Chrome для ранжирования. Но утечка показала, что это не так. Любите работать в удобном и привычном браузере, тогда эта информация покалечит и травмирует ваше сознание навсегда. Ваш любимый браузер передает абсолютно всю информацию о том, что вы делаете, какие сайты посещаете, сколько времени там проводите, куда кликаете, а это все влияет на то как поисковая выдача будет реагировать на сайты которые вы продвигаете.

Вот вам еще одна фобия если вы пользуетесь гугл диском для хранения важной инфы (контент планы, серые методы SEO работы или список ссылок, базы под хрумер и тд) — так вот гугл о вас знает и вы потенциальная жертва для понижения позиций ваших сайтов в выдаче.

Решили вы сделать для своего или клиентского сайта ПБН сетку (а Google такое страшно не любит). И вот вы составили контент план, на каждый сайт заходите с разных браузеров да еще и с vpn. Казалось что все в ажуре и гугл не догадается. Но предположим что вы ведете трелло, где размещаете посты или какую-то инфу о ваших сателлитах и заходите туда с хрома. Гугл просканирует абсолютно все что вы ему покажете. Любая малейшая оплошность выдаст вас и гугл очень быстро свяжет вас с пбн сеткой. Так что делайте выводы и меняйте браузер если основной у вас был Chrome.

Белые списки сайтов

Google создает списки сайтов, которым дает приоритет в определенных тематиках (медицина, выборы, финансы). Для большой части направлений есть специальные привилегированные сайты, которые будут забирать ваш трафик чтобы вы при это не делали. Если ваш сайт не входит в white list то в ТОП выдачу вы не попадете даже с экспертным контентом будучи врачом с 50-ти летним стажем. Теперь это обьясняет почему мелкие сайты так сложно продвигать, особенно в тематиках: медицина, крипта, финансы.

Остается открытым вопрос, по каким же критериям происходит отбор в белые списки?

Авторитет домена (siteAuthority) существует

Google всегда отрицал влияние Domain Authority, но мы то все догадывались и покупали дропнутые домены не просто так. А теперь и документы показали, что у компании есть есть своя скрытая метрика siteAuthority.

Что значит siteAuthority?

- Старые, проверенные сайты получают бонус в ранжировании (чем старше тем больше).

- Новый сайт сложнее раскрутить, даже если у него отличный контент (изгнание в песочницу).

- Ссылки с авторитетных сайтов передают гораздо больше веса, чем вы думаете, но Google старается не афишировать это.

С одной стороны мы все догадывались и знали это. Говорю за себя и специалистов олдов кто уже давно в теме. Крутить ссылки через несколько уровней и получать трастовые бэклинки с википедии и других авторитетных сайтов теперь придется всем чтобы хоть как-то конкурировать с агрегаторами.

Новые сайты попадают в песочницу Google

Google утверждал, что не использует «песочницу«, но утечка показала, что есть специальный фильтр hostAge, который унижажет новые сайты на свежерегах и не дает им полноценно вырасти.

Что это значит?

- Новый сайт не может быстро попасть в топ, даже если он идеально оптимизирован.

- Google некоторое время наблюдает за сайтом, проверяет, не спамит ли он.

- Если сайт быстро начинает получать трафик и ссылки, его могут держать в песочнице очень долго.

Была очень длинная дискуссия с моим товарищем по поводу песочнице и он топил за то, что это правильно и не будет выкидывать в ТОП выдачи всякое непотребство. С этим я категорически не согласен, и вот почему:

- Плохие и неоптимизированные сайты не попадут в ТОП по целой куче других критериев.

- Толковые сеошники с помощью серых и черных методов будет продвигать сайты на купленных дропах с большим возрастом.

- Пока хороший сайт будет сидеть в песочнице и ждать индексации старниц — твои статьи спарсят и выложат на другие сайты, где они проиндексируются быстрее и ты об этом даже не узнаешь.

При запуске нового проекта 10 раз подумайте о том какой домен выбрать новый или лучше поискать хороший дроп.

Размер бренда влияет на ранжирование

Известные компании получают приоритет в выдаче, даже если у них меньше ссылок. По сути это работает как количество обратных ссылок только в данном случае вместо ссылки выступает название бренда.

Как это работает?

- Чем больше упоминаний о бренде (даже без ссылок), тем выше он в выдаче.

- Если сайт неизвестный, ему сложно конкурировать даже с менее качественными материалами на брендовых сайтах.

- Google ориентируется на популярность ресурса в сети, а не только на контент.

Вот ведете вы свой личный блог например и пусть у нас будет хороший трафик на сайте и ссылочный профиль вы укрепляете, но сам бренд (название сайта или ваше ФИО) в интернете не сильно то и популярно. А есть такие сайты как: Habr, VC, Дзен и т.д.. Так вот если вы напишите несколько хорошо оптимизированных экспертных статей и выложите на свой сайт и на один из перечисленных — угадайте какая статья наберет более высокую позицию?

Фильтрация небольших сайтов

В документах Google есть специальный параметр, который помечает мелкие сайты и специально занижает их позиции в выдаче, если их страницы конкурируют с более крупными сайтами.

Что это значит?

- Если сайт небольшой и не получает ежедневно много трафика, Google специально понизит его позиции в выдаче.

- Это объясняет, почему маленькие блоги сложно продвигать против больших ресурсов.

- Google явно отдает предпочтение крупным сайтам и СМИ.

А это означает что нужно провести колоссальную работу по дополнительному написанию большого количества экспертного контента, привлечению трафика, бэклиенков, отзывов и т.д. чтобы вызвать доверие гугла и как награда будут в лучшем случае средние позиции на 1 странице в выдаче.

Метрика Font Size влияет на SEO

На самом деле и смешно и страшно. Раньше мы выделяли жирным ключевые слова чтобы гугл обращал на них внимание. Потом они нам говорили что это будет считаться переоптимизацией и лучше такое вообще не делать, а выделять только важные смысловые выражения в тексте.

Что это значит?

- Крупный шрифт важной информации повышает значимость ключевых слов.

- Google следит за структурой страницы: если заголовки H1, H2 и ключевые слова выделены мелким шрифтом, он может считать их менее значимыми.

Получается следующее: оптимизируем размер шрифта, делаем важные элементы большего размера, используем больше ключей в H-заголовках.

Google активно понижает сайты за неправильные ссылки

Demotion (понижения рейтинга) – множество факторов, по которым сайты могут терять позиции. В документах упоминаются разные типы «demotion» – вот такие например:

- Anchor Mismatch – если текст ссылки не совпадает с контентом страницы, сайт может потерять позиции.

- SERP Demotion – если пользователи не кликают по сайту в выдаче, он падает вниз.

- Location Demotion – глобальные сайты могут понижаться в поиске регионов.

Покупка дешевых ссылок или использование софта по типу хрумера или GSA может отправить ваш сайт в чистилище гугла до нескончаемых времен.

Что теперь делать и как менять SEO стратегию?

Конечно все что здесь изложено, давно было в догадках и по большей части все значи о песочнице, брендах с белых списках. Для многих возможно будет новой или даже шокирующей информацией. Но не стоит падать духом. Сайты как и раньше будут расти если прикладывать усилия и делать качественный контент, хорошую техничку на сайте, получать трастовые бэклинки.

Самое важное это тестировать все самому, не доверять а проверять (особенно одной поисковой системе). Задумайтесь над сменой основного браузера если не все ваши методы белые.

Не стоит тратить время на низкобюджетные проекты в конкурентных нишах по типу финансов и медицины — вы тупо не вытяните, потеряете время и деньги.

Мое мнение сложилось такое: Гугл выступает в роли государства, которое решило задушить малый бизнес, а вы делайте выводы сами…

Те що треба!